Stable Diffusion: Riffusion

In unseren vorangegangenen Artikeln haben wir die faszinierenden Möglichkeiten von Stable Diffusion zur Erzeugung fesselnder Bilder erkundet. Es ist jedoch wichtig zu wissen, dass dieses leistungsstarke generative neuronale Netzwerk noch mehr zu bieten hat.

Riffusion ist ein Stable Diffusion-Modell für die Erstellung und Bearbeitung von Musik. Mit Riffusion können Sie ein Spektrogramm eines gewünschten musikalischen Segments erzeugen und es mühelos in einen musikalischen Ausschnitt verwandeln. Lassen Sie uns Riffusion auf einem LeaderGPU-Server installieren und in Aktion ausprobieren.

Voraussetzungen

Aktualisieren Sie zunächst das Paket-Cache-Repository und die installierten Pakete:

sudo apt update && sudo apt -y upgradeVergessen Sie nicht, die Nvidia-Treiber mit dem Befehl autoinstall oder manuell mit Hilfe unserer Schritt-für-Schritt-Anleitung zu installieren:

sudo ubuntu-drivers autoinstallStarten Sie den Server neu:

sudo shutdown -r nowFür die Erstellung einer virtuellen Umgebung empfehlen die Entwickler ein Tool namens Anaconda. Sie können auch venv verwenden, das wir in der Anleitung zu den Linux-Systemdienstprogrammen besprochen haben. Laden Sie das Anaconda-Installationsskript mit curl herunter:

curl --output anaconda.sh https://repo.anaconda.com/archive/Anaconda3-5.3.1-Linux-x86_64.shMachen Sie es ausführbar:

chmod +x anaconda.shUnd ausführen:

./anaconda.shBeantworten Sie alle Fragen mit JA, außer der letzten (Microsoft VSCode installieren). Melden Sie sich dann erneut an der SSH-Konsole an und erstellen Sie eine neue virtuelle Umgebung mit Python v3.9:

conda create --name riffusion python=3.9Aktivieren Sie die neue virtuelle Umgebung:

conda activate riffusionWenn Sie andere Musikformate als wav verwenden möchten, müssen Sie auch das FFmpeg-Bibliotheksset installieren:

conda install -c conda-forge ffmpegRiffusion installieren

Klonen Sie das Riffusion-Repository:

git clone https://github.com/riffusion/riffusion.gitÖffnen Sie das heruntergeladene Verzeichnis:

cd riffusionLassen Sie uns einige Änderungen in der Anforderungsdatei vornehmen. Dies verhindert Fehler bei der Kompatibilität der Taschenlampe:

nano requirements.txtPaketversionen finden und korrigieren:

diffusers==0.9.0

torchaudio==2.0.1Speichern Sie die Änderungen und fahren Sie mit der Vorbereitung einer virtuellen Umgebung fort. Mit dem folgenden Befehl werden alle erforderlichen Pakete installiert:

python -m pip install -r requirements.txtSchließlich können Sie eine "Spielwiese" öffnen. Dies ist eine einfache Weboberfläche, die Ihnen hilft, mehr über die Funktionen von Riffusion zu erfahren:

python -m riffusion.streamlit.playgroundÖffnen Sie Ihren Lieblingsbrowser und geben Sie die Adresse http://[SERVER_IP]:8501/

Testen Sie einen Spielplatz

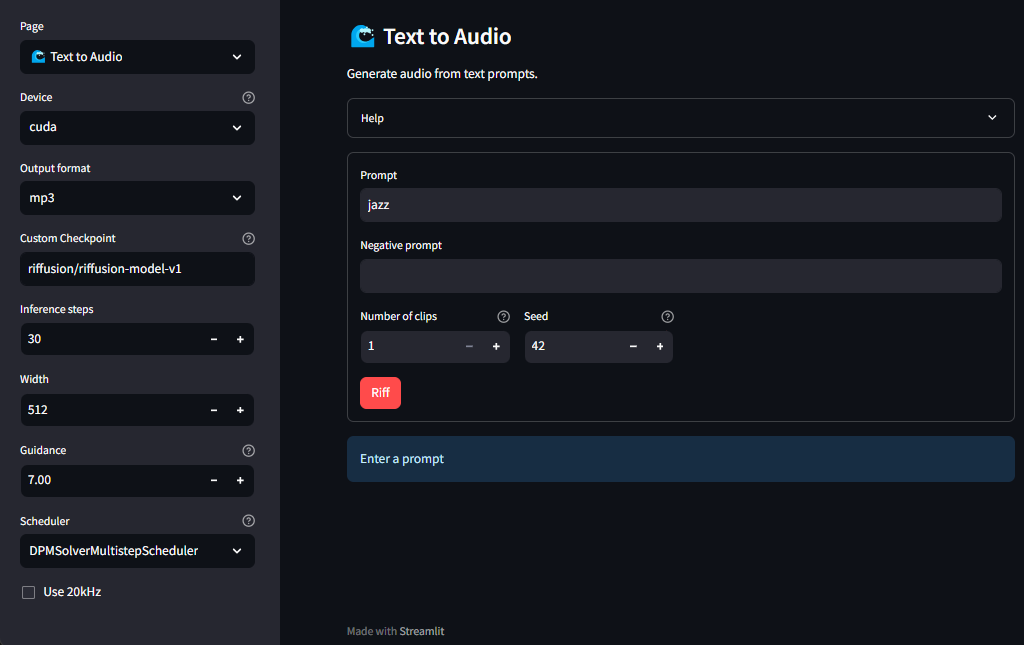

Jetzt können Sie mit Hilfe von Textaufforderungen und durch Ändern der anderen Parameter Musik erzeugen:

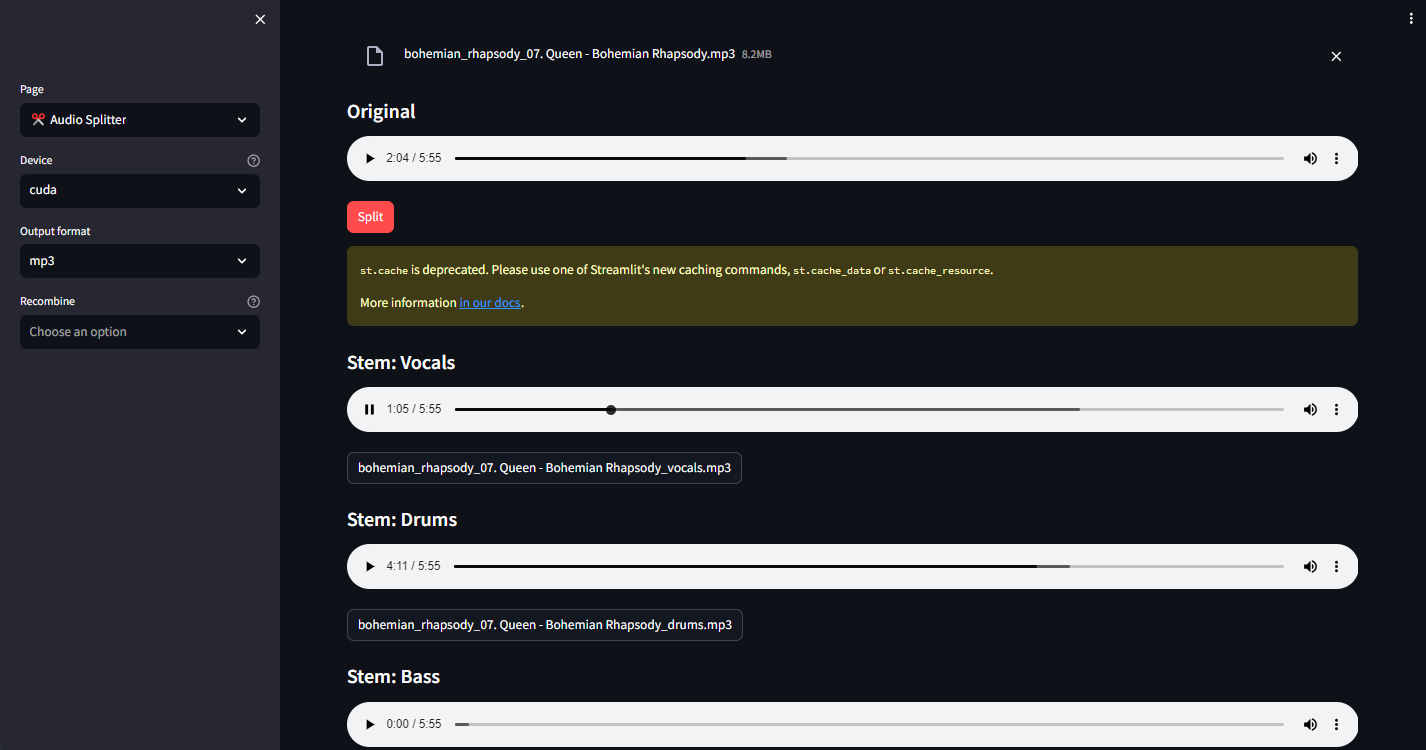

Außerdem können Sie einige knifflige Dinge tun, wie z. B. das Aufteilen von Audio in einzelne Komponenten. Zum Beispiel können Sie die Stimme aus Bohemian Rhapsody von Queen extrahieren:

Denken Sie daran, dass dies nur ein einziges Beispiel dafür ist, wie Riffusion genutzt werden kann. Wenn Sie Ihre eigene Anwendung erstellen, können Sie wesentlich fesselndere Ergebnisse erzielen. Leistungsstarke Server von LeaderGPU kümmern sich um die Berechnungen.

Siehe auch:

Aktualisiert: 04.01.2026

Veröffentlicht: 21.01.2025